De zelfrijdende auto is terug

Hoe nieuwe AI-modellen de belofte van autonome mobiliteit nieuw leven inblazen

Hoi iedereen,

Wanneer je nadenkt over de toekomst komen er regelmatig hypes op je af die je vervolgens op waarde moet zien in te schatten. Voorzichtigheid is dan geboden. Vooral met voorspellende tijdslijnen. Wij denken dan vaak even aan de oude futurologenwijsheid van Roy Amara:

We neigen de effecten van een technologie op de korte termijn te overschatten en op de lange termijn te onderschatten.

Het is een wijsheid die met name op gaat voor technologische ontwikkelingen wiens uiteindelijke inzetbaarheid afhankelijk is van ingewikkelde (vaak nog niet bestaande) waardeketens. Voordat deze zijn opgetuigd ben je zo enkele decennia verder. Maar als ze er dan zijn kunnen de sociale en maatschappelijke effecten opeens veel groter zijn dan je in eerste instantie dacht.

Zo hebben we al een tijdje niet meer geschreven over de zelfrijdende auto. De afgelopen tijd waren er ook geen noemenswaardige ontwikkelingen; de zelfrijdende auto leek een doodlopende weg te zijn ingeslagen. De hype was er wel een beetje vanaf. Toch hielden we altijd met een schuin oog de AV-space in de smiezen. Zeker na de komst van generatieve AI. Het laatste jaar zagen we echter weer een aantal interessante ontwikkelingen. Hoog tijd dus voor een update.

Zo’n update over zelfrijdende auto’s, ook wel autonomous vehicle (AV) genoemd, leidt ook automatisch tot een reflectie over ons mensbeeld en hoe vertrouwen is geconstrueerd in onze samenleving. Dus deze week ook wat gedachten over hoe de opkomst van AV’s (en andere vormen van AI) beide kan veranderen.

Mocht de zelfrijdende auto opeens ons straatbeeld domineren, dan zal hij nog veel meer gaan veranderen. Van stedenbouw, planologie, klimaatbeleid, tot mondiale grondstoffenketens – alles zal terug naar de tekentafel moeten. Om nog maar te zwijgen over de Duitse en Japanse economieën die onevenredig zijn opgebouwd rondom de auto-industrie.

Maar het zal ook een diepere cultuurverandering aanjagen. Onze beleving van tijd en ruimte zal verschuiven. De zelfrijdende auto heeft effect op waar we zullen wonen, werken en recreëren en hoe we betekenisvolle relaties onderhouden. Ook zal het mogelijk onze notie van individueel bezit veranderen, want het natuurlijke verdienmodel van zelfrijdende auto’s is als dienst.

Kortom, hoewel de zelfrijdende auto misschien niet het meest sexy onderwerp is, is het wel een belangrijk onderwerp. En er gebeuren opmerkelijke dingen in de AV-space.

De zelfrijdende auto is terug

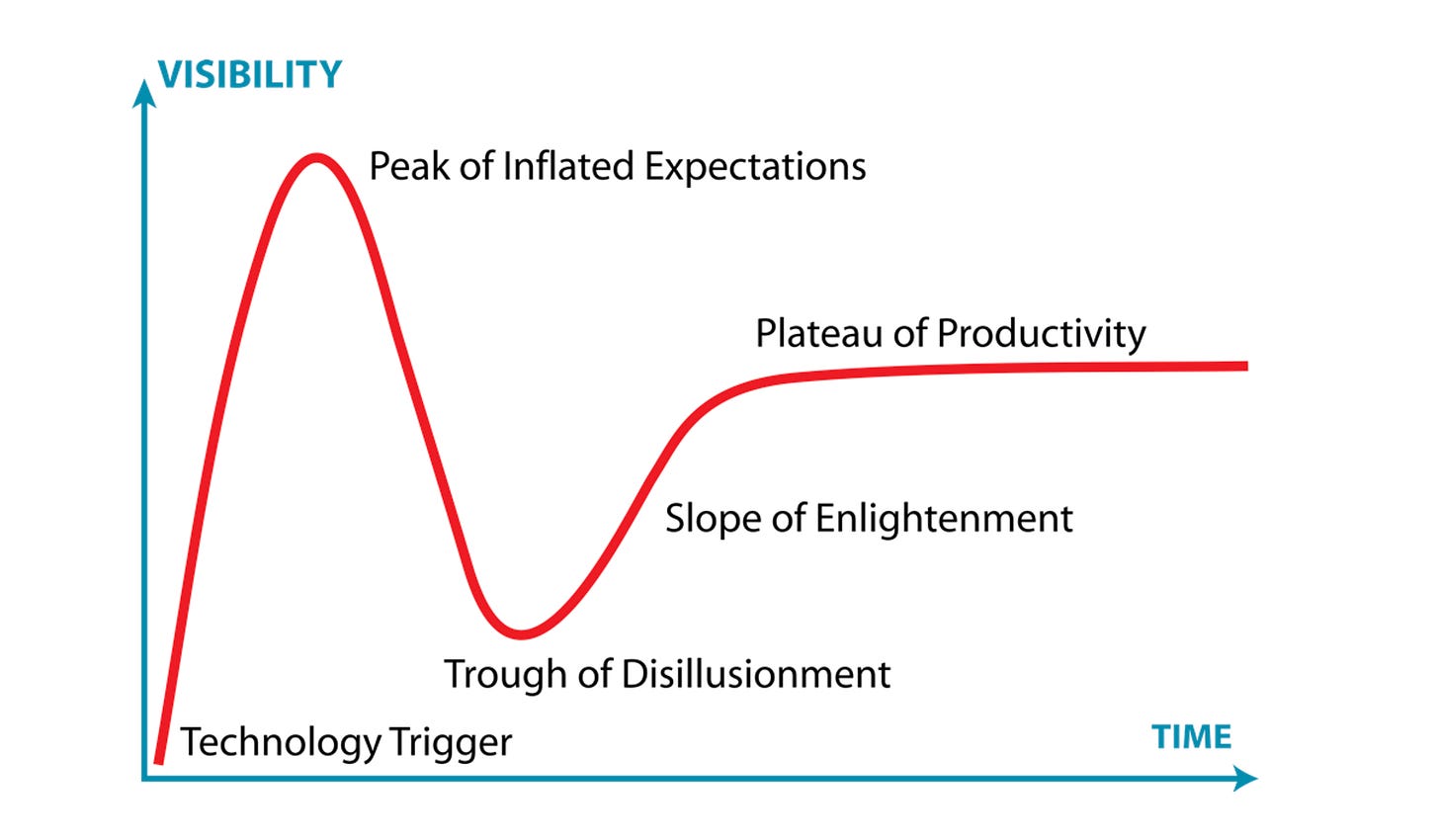

Zo’n tien jaar geleden, ongeveer rond de tijd dat wij met Studio Monnik begonnen, beloofden technologiebedrijven zoals Google en Tesla dat auto’s rond 2018 volledig autonoom zouden kunnen rondrijden, ongeacht locatie of omstandigheden. Dat bleek overmoedig. Honderd miljard dollar aan investeringen later dook de AV rond 2018 juist diep de ‘trog van desillusie’ in, de fase in de Gartner hype cycle waarin niemand nog vertrouwen lijkt te hebben in de technologie.

Op het eerste gezicht lijkt het alsof de AV vandaag de dag nog steeds blind rondjes rijdt op de bodem van de trog. Zo ontsloeg Cruise (van General Motors) in december nog 24 procent van zijn personeel, nadat één van hun AV’s een voorbijganger had geschept, waardoor hun vergunning werd ingetrokken. Maar de schijn bedriegt wellicht. Er zijn spannende nieuwe ontwikkelingen gaande.

Een nieuwe generatie AV-bedrijven, met een nieuwe AI-benadering oor zelfrijdende auto’s, heeft het afgelopen jaar opmerkelijke resultaten geboekt. Het meest spraakmakende onder deze jonge bedrijven is Wayve, een Londens AV-bedrijf, opgericht in 2017.

Wayve slaagde er vorig jaar in om een zelfrijdende AI te ontwikkelen die (1) zonder gebruik te maken van digitale kaarten en Lidar (Light Detection and Ranging, een soort gedetailleerde radar); (2) prima kan rijden in steden waarin het niet is getraind; (3) in autotypen waarin het nooit eerder de weg is opgegaan. Met andere woorden, als de AV is getraind met een sedan in Londen, kan het met die kennis ook een bestelbus naar en door Manchester rijden.

Wayve’s prestaties waren groot nieuws in de AV-space, waar het uiteindelijke doel is om een zelfrijdende AI te creëren die kan generaliseren, en boven de trainingsdata uit kan stijgen. Hoe Wayve deze successen heeft bereikt, terwijl de oude rotten in het vak – zoals Waymo, Cruise en Tesla – al jaren geen nieuwswaardige vooruitgang meer boeken, komt doordat het een andere AI-benadering heeft omarmd.

End-to-end machine learning

Wayve maakt gebruik van end-to-end machine learning. Hoewel de oudere AV-bedrijven ook zwaar leunen op machine learning – bij beeldherkenning, het maken van rijbesluiten en bij het aansturen van de auto – zijn deze AI-systemen onderling nog van elkaar gescheiden. Ze worden ‘handmatig’ aan elkaar gekoppeld met als-dit-dan-dat-programmatuur. Deze gefragmenteerde benadering is een erfenis van de cutting edge in robotica in 2007, toen de ontwikkeling van AV’s momentum kreeg na de Darpa Urban Challenge.

Wayve, daarentegen, maakt gebruik van maar één geïntegreerd AI-model. Eén enkel model dat het hele proces holistisch bestuurt; van beeldherkenning tot rijbesluiten. En dat ook zo is getraind. Het AI-model van Wayve leerde het verschil tussen een fietser, een auto en een huis, terwijl het tegelijkertijd leerde hoe verkeer zich gedraagt, hoe het richting moest aangeven en moest sturen, schakelen, remmen, etc.

Deze eerder nog strikt gescheiden processen zijn door Wayve’s AI-model verweven tot één geïntegreerde logica, waarbij het waarnemen van de wereld, het begrijpen van die wereld en het handelen in die wereld niet meer uit elkaar te trekken zijn. In ieder geval, dat is het idee. En gezien de prestaties van het jonge bedrijf lijkt het idee ook niet ontdaan van enige verdienste.

In de demonstratie hierboven rijdt Wayve-oprichter Alex Kendall in gezelschap van Azeem Azhar in een van Wayve’s AV’s door het centrum van Londen. De AV navigeert feilloos door de drukke en chaotische straten. Het reageert verstandig doch assertief op zwabberende fietskoeriers, wegvernauwingen, dubbelparkeerders, gevaarlijk overstekende voetgangers, verkeersdrempels, politiefuiken en andere lastige wegsituaties. Hoewel anekdotisch, is het best een indrukwekkende demonstratie.

In de manier waarop de AV besluiten maakt wordt er bij Wayve dus geen gebruik meer gemaakt van expliciete handgeschreven programmatuur. Deze AI-first-benadering staat bekend als AV2.0. Naast Wayve zweren ook startups als Ghost, Waabi en Autobrains bij deze benadering, alhoewel ieder weer op een andere manier. De benadering heeft uiteraard een grote boost gekregen door de recente ontwikkeling van generatieve AI – denk aan ChatGPT. AI-modellen zijn nu exponentieel krachtiger dan in 2007.

Nieuwe AI-modellen

AI-modellen waren in 2007 nog vooral gebaseerd op symbolische logica. In 2012, met de opkomst van machine learning, werden ze goed in het categoriseren van data, zoals bij beeldherkenning. Sinds de ontwikkeling van generatieve AI kunnen ze ook hun eigen datasets genereren, zoals ChatGPT doet. En nu beginnen AI-modellen goed te worden in actie en interactie (met mensen, met ‘domme’ apps, met elkaar en met de fysieke wereld).

Het AI-model waarmee Wayve werkt is een visual-language-action-model (VLAM). Het kan zien (categoriseren), praten (genereren) en handelen (actie). Of, in ieder geval, dat is de bedoeling.

Wayve werkt op dit moment namelijk nog met drie afzonderlijke AI-modellen die, op een manier die voor ons niet helemaal duidelijk is, worden geïntegreerd in een zelfrijdende AI. Zo presenteerde Wayve dit jaar zowel LINGO-1, een large language model (LLM) waarbij je de auto kan bevragen, als GAIA-1, een worldbuilding generator die in hoge resolutie allerlei realistische verkeerssituaties kan bedenken en simuleren.

Het idee is dat deze twee AI-modellen op een holistische manier worden geïntegreerd met het rijmodel. Door GAIA-1 kan de zelfrijdende auto tijdens het rijden potentiële verkeersscenario's verkennen, waardoor het vooruit kan denken. Niet onbelangrijk voor een chauffeur. En via LINGO-1 kan het zijn beslissingen en overwegingen uitleggen aan de menselijke inzittenden.

Hoe dit laatste werkt is ons overigens niet helemaal duidelijk; want hoe weet je nou of LINGO-1 de beslissingen of overwegingen van het rijmodel interpreteert (genereert) of daadwerkelijk registreert? Of dat het alleen de input van de camera’s interpreteert?

Uiteindelijk zal het duidelijk worden bij het gebruik van het model. Als het commentaar van LINGO-1 en het rijgedrag lange tijd overeenkomen, kan je wellicht de conclusie trekken dat ze verenigd zijn in een holistisch systeem. Check in het filmpje hierboven hoe Alex Kenball met de auto praat. Wat sowieso opvalt is hoe scherp LINGO-1 zijn omgeving kan beschrijven.

Kenbaarheid en vertrouwen

Als LINGO-1 daadwerkelijk inzicht heeft in de rijbeslissingen en tactische overwegingen van de zelfrijdende auto, dan zou dat uiteraard een grote stap zijn richting de interpretability van het AI-systeem.

Het probleem van interpretability raakt aan een van de hoogste barrières waar zelfrijdende auto’s nog doorheen moeten voordat ze geaccepteerd kunnen worden door zowel het grote publiek als de wet- en regelgever: vertrouwen in hun agency. De redenaties achter de beslissingen van een machine learning AI-model zijn vooralsnog onkenbaar. Het zijn zwarte dozen die beslissingen genereren op een statistische manier, dus technisch gezien kan je überhaupt niet van redenaties spreken.

Dit klinkt voor velen als een totale no-go. Want hoe kan je je verlaten op een model waarvan je niet weet hoe het besluiten maakt? En hoe kan je schuld en aansprakelijkheid bepalen als het motief van een AI-model een mysterie blijft, of er gewoon niet is?

Kenbaarheid of leesbaarheid lijkt noodzakelijk voordat een machine learning model zijn weg door de echte wereld mag banen. (Zo kiest de startup Ghost juist om die reden voor een heel andere aanpak.) Maar wij denken eigenlijk dat het gebrek aan kenbaarheid of leesbaarheid helemaal geen onoverkomelijk probleem is, of hoeft te zijn. Om de simpele reden dat ook mensen zwarte dozen zijn, die hun beslissingen pas achteraf van een verklarende of legitimerende redenatie voorzien.

Niemand weet immers hoe een stel hersenen tot besluiten komt. Zelfs niet de persoon aan wie de grijze massa in kwestie toebehoort. Meestal doe je dingen op gevoel, instinct, intuïtie, routine of op spierintelligentie. Dat zijn manieren om te zeggen dat er geen bewuste redenatie aan het besluit is voorafgegaan. De meeste beslissingen neem je onbewust. Je onleesbare brein neemt deze beslissingen, je bewuste zelf kan er hoogstens naderhand wat logische verklaringen bij zoeken. Niet ongelijk Wayve’s LINGO-1 dus, mocht het zo zijn dat LINGO-1 de besluitvorming van de zelfrijdende auto slechts interpreteert i.p.v. registreert.

In onze samenleving hebben we het vaak over individuele en collectieve keuzevrijheid. Onze hele samenleving is erop ingericht. Maar eigenlijk weten we helemaal niet wat keuzevrijheid is, en of het er überhaupt is. En toch vertrouwen we elkaar, in ieder geval genoeg om de weg met elkaar te delen. En als het fout gaat dan accepteren we dat mensen (of hun onleesbare grijze massa’s) weleens fouten maken.

Ook als een systeem als LINGO-1 niet representatief is voor de rijbesluiten van de AV, zullen AV’s op een gegeven moment wel worden geaccepteerd, vermoeden wij. Naarmate de capaciteiten van zelfrijdende auto’s groter worden en hun foutmarges zakken tot ver onder die van menselijke verkeersdeelnemers, zullen we, onzes inziens, moeten erkennen dat ook fouten van AI-systemen tot op zekere hoogte aanvaardbaar zijn. Tot op zekere hoogte, want je kan ze beter voorkomen. En nee, je moet niet je kernwapenarsenaal laten aansturen door een AI, zodat jij lekker een potje kan golven.

Acceptatie van AV’s vereist dan vooral een cultuurverandering. Die verandering zal vooral bestaan uit een verschuiving in ons dominante mensbeeld. Want als we accepteren dat individuen in de meeste gevallen óók geen beredeneerde besluiten maken – we zijn immers geen ouderwetse robots – kunnen we misschien accepteren dat zelfrijdende auto’s ook geen ouderwetse robots meer zijn. Wat ze dan wel zijn? In het slechtste geval zijn ze mysterieus, net als wij.

Kunstmatige Moraliteit

Bij TNO denken ze hier overigens iets anders over. Volgens dit artikel in de Volkskrant proberen ze daar, op basis van risicoprofielen, zelfrijdende auto’s met de hand zodanig te programmeren dat ze te allen tijde kiezen voor de minst risicovolle route. Zodat het gedrag van de auto in het geval van een verkeersprobleem altijd achterhaalbaar is.

Het ontwikkelen van risicoanalyses is een interessante toevoeging aan het besluitvormingsproces van de AI. Maar, zoals het artikel ook aangeeft, je moet dan ook met de hand invoeren wat iets waard is. Als een AV moet kiezen tussen het aanrijden van een pylon en het aanrijden van een kind is die keuze niet zo moeilijk, maar als het moet kiezen tussen het aanrijden van een kind en het aanrijden van twee kinderen, of tussen het scheppen van een kind en een bejaarde, wat voer je dan in als programmeur?

Het is niet voor niets dat we als samenleving dit soort waardebepalingen liever in het vage laten. We hebben hier simpelweg geen antwoord op. Als je als 18-jarige voor je theorie-examen gaat krijg je immers ook geen vraag over de onwaarschijnlijke keuze tussen het aanrijden van één of twee kinderen. Deze beslissing laten we dus gemakshalve over aan de bestuurder, of aan het moment waarop blinde paniek de grootste besluitvormer is.

De benadering van TNO opent bovendien de deur naar weer hele andere morele vraagstukken. Wat bijvoorbeeld als een AV moet kiezen tussen twee kinderen. Krijgt de AV dan in een splitsecond toegang tot de medische of sociaaleconomische gegevens van deze kinderen? Zodat de AV, mocht één kind ongeneeslijk ziek zijn of uit een ‘kansarm’ milieu komen, een beter geïnformeerde keuze kan maken?

Het zijn onmogelijke maar vooral onzinnige vraagstukken. Het maken van risicoprofielen zegt vooral iets over onze drang om alles, zelfs de waarde van een mensenleven, te willen kwantificeren.

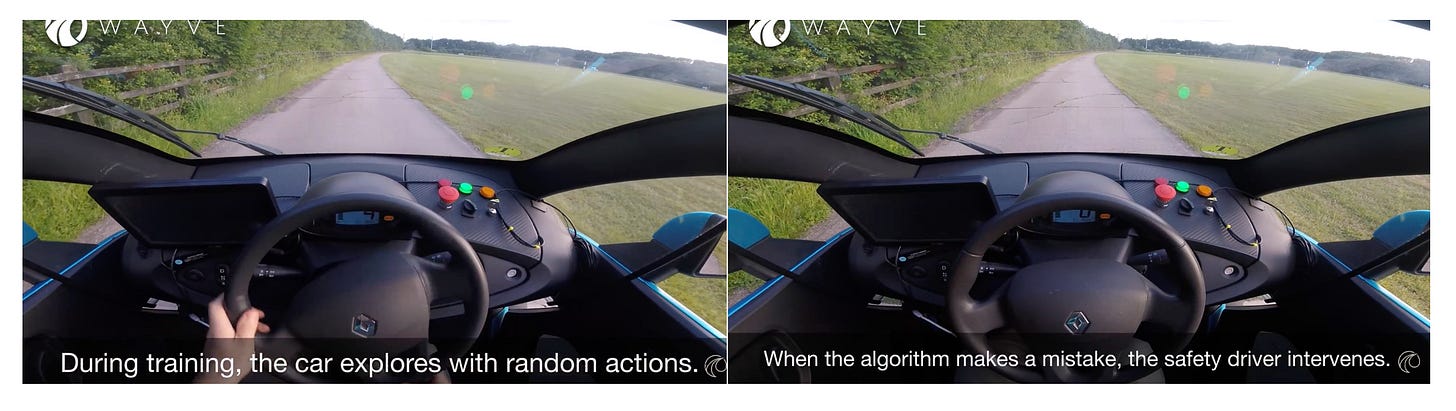

Het is bovendien niet zo dat we machine learning AI’s geen waarden meegeven. Integendeel. Ze leren alleen door reinforcement. Door aan te geven wanneer ze iets goed of iets fout doen leren ze op den duur een eigen inschatting te maken van een situatie, ook op moreel niveau. Want dat hebben ze impliciet meegekregen, binnen de reinforcement.

Bovenstaande frames vertellen kort de logica achter reinforcement learning. Zie hier het hele filmpje. In het filmpje zie je hoe een in beginsel totaal ongetrainde en onwetende Wayve AV binnen 20 minuten leert dat het de bedoeling is dat je op de weg rijdt en niet naast de weg. Na honderdduizenden uren reinforced learning en ontelbare correcties wordt impliciet dus ook een moreel besluitvormingskader gecreëerd.

Uiteindelijk gaat het, onzes inziens, om de foutmarges. Net als bij alle technologie.

Er is immers altijd een kans dat je fiets kapot gaat midden op een kruispunt, of dat de remmen van je auto het begeven als je de Brennerpas afdaalt, of dat de gondel van je skilift naar beneden kukelt. Die kans is alleen minuscuul. En daarom nemen we nog steeds de fiets, de auto en de skilift. Om niet te spreken van achtbanen en kermisattracties, waar we misschien juist instappen omdat een goede afloop fundamenteel ongewis is.

Wellicht is LINGO-1 echt een doorbraak in de interpretability van embodied-AI. Maar als dat niet zo is, dan vermoeden wij dat op het moment dat AV’s het verkeer kunnen navigeren met foutmarges die een-honderdste of een-duizendste zijn van die van een gemiddelde mens, we er gewoon voor zullen gaan. En dat ze vervolgens langzaam de weg van ons overnemen. Maar zo ver zijn we uiteraard nog niet, als het al zo ver komt. Het enige wat we nu met zekerheid kunnen zeggen is dat de AV-space dit jaar weer een stuk spannender is geworden.

Fijn (lees)weekend!

❤️

Edwin en Christiaan